El uso de inteligencia artificial (IA)para crear rostros y voces falsos ha pasado de la ficción al delito. Una reciente estafa en Hong Kong, donde un empleado transfirió 25 millones de dólares tras una videollamada con una recreación digital de su director ejecutivo, confirma la magnitud del riesgo.

Datos de la firma Sumsub revelan que los fraudes con deepfakes aumentaron en 700% en el primer trimestre de 2025, afectando a bancos, plataformas digitales y organismos públicos. La imitación se ha vuelto tan precisa que distinguir lo real de lo falso representa un reto para cualquier organización.

Únete a nuestro canal de WhatsApp

El avance de herramientas como Veo3 de Google, capaces de generar videos hiperrealistas, amplifica la vulnerabilidad. Aunque estas tecnologías incorporan mecanismos éticos, los ciberdelincuentes las utilizan para perfeccionar engaños que pasan inadvertidos incluso ante ojos entrenados.

Deepfakes y la IA como escudo

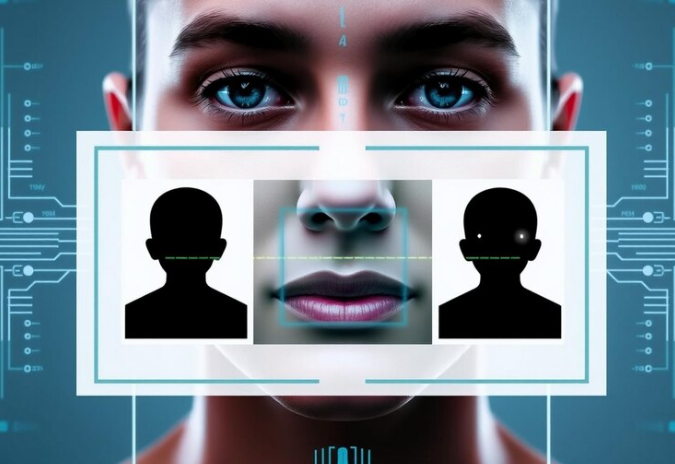

Frente a este panorama, la verificación de identidad en tiempo real se ha convertido en una necesidad. Tecnologías de biometría facial, detección de vida y machine learning permiten reconocer microgestos y patrones digitales imposibles de replicar. Cada intento de fraude detectado fortalece el sistema, anticipando nuevas amenazas.

Lee también: México consolida su posición como exportador de bienes que habilitan la Inteligencia Artificial

La integración de la IA con revisión humana ofrece una defensa en capas. Además, la adopción de medidas como alertas automatizadas, verificación biométrica y monitoreo contextual ayuda a prevenir pérdidas financieras y preservar la confianza.

¿Cómo protegerse?

Especialistas recomiendan adoptar medidas avanzadas de seguridad digital:

- Validar la identidad mediante biometría facial.

- Activar sistemas de detección de vida.

- Revisar patrones de comportamiento y ubicación.

- Configurar alertas automáticas ante operaciones inusuales.

- Consultar con expertos en caso de sospecha.

Fuente: Freepik

Las soluciones basadas en inteligencia artificial permiten diferenciar rostros reales de animaciones en milisegundos. Su combinación con monitoreo humano crea un blindaje más confiable.

El caso de Hong Kong deja una lección contundente: la sofisticación tecnológica no solo potencia el delito, también exige respuestas igual de avanzadas. En el mundo digital, un rostro falso puede vaciar una cuenta en segundos.

¡Consulta todo nuestro contenido y sigue a Mundo Ejecutivo CDMX en Google News!